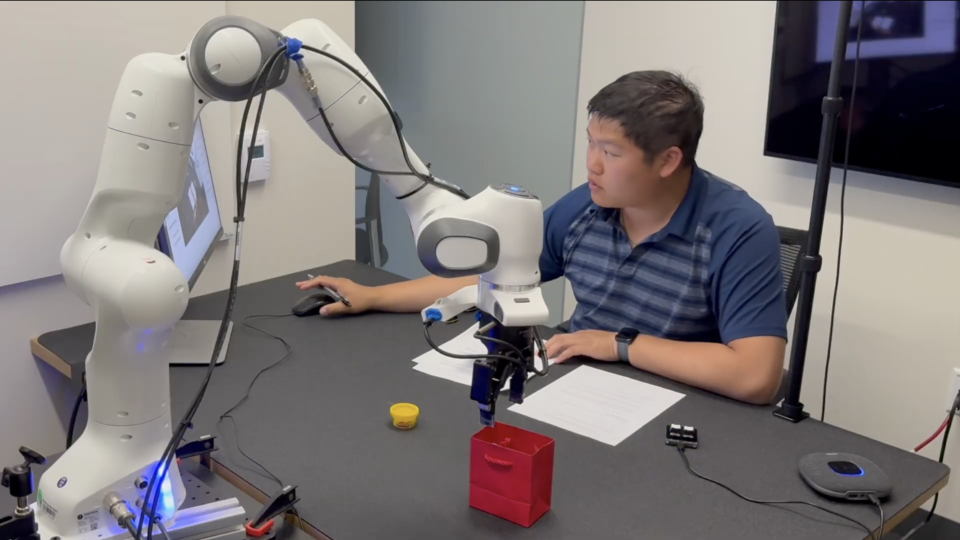

Por Catalina Miller . En Los Supersónicos , una caricatura futurista que se estrenó en 1962, la familia titular contrató a Rosie, la robot, para lavar la ropa, limpiar la casa, cocinar y ayudar a cuidar a los niños. Más de 60 años después, todavía no tenemos un robot como Rosie que satisfaga nuestras necesidades diarias, a pesar de los importantes esfuerzos en esa dirección, dice Jennifer Grannen , estudiante de posgrado en informática en la Universidad de Stanford. “Todo el mundo está realmente interesado en impulsar las capacidades de los robots autónomos, pero siempre habrá alguna situación fuera de los datos de entrenamiento en la que un robot completamente autónomo va a fallar”, dice Grannen. Entonces, Grannen y sus compañeros estudiantes de posgrado en ciencias de la computación Siddharth Karamcheti y Suvir Mirchandani , con los profesores asociados Dorsa Sadigh y Percy Liang , establecieron un objetivo diferente: diseñar un robot doméstico no autónomo que pueda colaborar con las personas y aprender en el trabajo. "Nos interesaba explorar lo que se necesitaría para implementar robots con personas", dice Karamcheti. Si un robot te ayuda a cocinar, tal vez sostenga la olla mientras revuelves. Si estás preparando el almuerzo para la familia una mañana, te ayuda a preparar cada una de las bolsas del almuerzo. Y más: le estás diciendo verbalmente qué hacer y, si no sabe cómo, te pedirá instrucciones. Como dice Grannen: “Deberíamos aprovechar el hecho de que tenemos humanos en casa que saben lo que debe hacer el robot y pueden brindar retroalimentación para ayudarlo a aprender”. El equipo presentó un prototipo de un sistema robótico de este tipo llamado Vocal Sandbox en la octava conferencia anual sobre aprendizaje robótico en septiembre de 2024. Vocal Sandbox, financiado en parte por el Instituto de Stanford para la IA centrada en el ser humano , utiliza un modelo de lenguaje grande (LLM) para comprender comandos verbales y, en tiempo real, pedir ayuda para identificar nuevos objetos y aprender nuevos movimientos y comportamientos complejos. Karamcheti espera que Vocal Sandbox sea el primero de muchos sistemas que nos ayudarán a integrar gradualmente los robots en nuestras vidas. “Cuanto más fácil sea para la gente enseñar a los robots cosas sencillas, antes podremos incorporar estos robots a la vida de las personas para que empiecen a ofrecerles alguna utilidad”, afirma. El arenero vocal en acción La configuración física de Vocal Sandbox consta de un brazo robótico, un par de cámaras, una computadora portátil y una interfaz gráfica de usuario (GUI) que muestra al usuario humano lo que planea hacer el robot. También hay mucho que hacer detrás de escena, incluido el reconocimiento de voz automático; un sistema de texto a voz que permite la comunicación de voz en tiempo real por parte del robot; un modelo de puntos clave aprendido que ayuda al robot a identificar objetos por nombre y ubicación; y un modelo de movimiento dinámico que puede aprender movimientos a partir de demostraciones kinestésicas. Pero lo que es realmente nuevo aquí es el marco de aprendizaje Vocal Sandbox que permite al sistema aprender habilidades de bajo y alto nivel sobre la marcha usando un LLM (GPT-3.5 Turbo). Las habilidades de bajo nivel pueden considerarse como la comprensión de verbos y sustantivos particulares que el LLM traduce en código que produce acciones específicas del robot. Los comportamientos de alto nivel pueden considerarse como una combinación de verbos y sustantivos conocidos que juntos comprenden un nuevo comportamiento. El equipo demostró la utilidad del marco Vocal Sandbox en dos situaciones: ayudar a una persona a empacar una bolsa de regalo y controlar la cámara mientras una persona colocaba piezas de Lego para crear una animación stop-motion. En el caso de la bolsa de regalo, una habilidad de bajo nivel podría ser la capacidad de ejecutar una acción específica, como “recoger el coche de juguete”. Si el robot ya sabe el significado de “recoger”, pero no sabe cómo identificar un coche de juguete, podría decir: “No sé qué quieres decir con el coche de juguete. ¿Me lo puedes mostrar?”. El humano haría clic en la imagen del coche de juguete en la interfaz gráfica de usuario, lo que le enseñaría al sistema la nueva habilidad de bajo nivel de cómo se ve un coche de juguete. Si el usuario que ensambla las bolsas de regalo quiere que el robot use una habilidad de nivel superior, como “empacar el auto de juguete en la bolsa de regalo”, le explicará: “Empacar significa recoger el auto de juguete, ir a la bolsa de regalo y soltar”. Y como el robot ya conoce las acciones “recoger”, “ir a” y “soltar”, puede realizar ese nuevo comportamiento de nivel superior de “empacar” artículos a partir de ese momento, dice Grannen. Vocal Sandbox también permite que el robot aprenda movimientos kinestésicos. Por ejemplo, en el escenario de acción stop-motion, el usuario le pidió al robot que “hiciera zoom” sobre Iron Man, y el robot le preguntó qué significaba “hacer zoom”. Luego, el usuario movió manualmente la cámara de un lugar a otro para demostrar la acción de hacer zoom. Con cada instrucción que recibe el sistema, el robot muestra su plan de acción en la interfaz gráfica de usuario y pregunta al usuario si el plan es correcto antes de ejecutarlo, una importante función de seguridad. “La interfaz gráfica de usuario muestra la receta que va a seguir el sistema, paso a paso”, afirma Karamcheti. Identifica con qué objeto va a interactuar y muestra la curva que seguirá el brazo robótico para realizar la acción solicitada. Y el usuario tiene que decir “OK” antes de que el robot haga algo. “Esta modularidad es el mecanismo clave que tenemos ahora para la confianza y la fiabilidad”, afirma. Ambos experimentos demostraron la eficiencia del marco Vocal Sandbox. Pero el uso del robot como cámara para la película stop-motion resultó particularmente eficiente. Crear animación stop-motion puede resultar tedioso porque hay que disponer las cámaras con mucha precisión, al mismo tiempo que se disponen las piezas de Lego y se dirige la historia, afirma Grannen. “Al utilizar un robot como compañero, se puede centrar la atención en las partes creativas de la tarea y, además, desbloquear una aceleración enorme”. Pasando a configuraciones realistas Pronto, Grannen espera probar Vocal Sandbox en un entorno real. Ha estado hablando con una panadería local sobre cómo podrían beneficiarse de una mano extra. La idea sería llevar el robot a la panadería y, sin programarlo para una tarea específica de panadería, ver si los empleados pueden enseñarle a hacer cosas útiles en poco tiempo. ¿Podrían enseñarle a cortar verduras, sacar sartenes calientes del horno o poner croissants en una canasta en el estante de exhibición? “Realmente queremos ver qué eligen hacer los usuarios cuando trabajan con el robot”, dice Grannen. “¿Qué creatividad libera y qué tipo de cosas pueden lograr?” Grannen también está interesado en utilizar Vocal Sandbox para ayudar a los adultos mayores y a las personas con discapacidades. “Para ser un cuidador eficaz, hay que poder personalizar y recibir comentarios del paciente”, afirma Grannen. “En mi opinión, este trabajo supone un gran paso en esa dirección”. Por ejemplo, dice, Vocal Sandbox sería un impulso a su trabajo previo con la alimentación asistida al brindarles a los usuarios la capacidad de enseñarle al sistema nuevos alimentos o nuevos comportamientos de nivel superior como "dame la sopa" en lugar de "toma la cuchara, saca un poco de sopa, llévatela a mi boca". Vocal Sandbox podría incluso permitir el baño asistido cuando se combina con una pinza adecuada, que Grannen ha estado ayudando a desarrollar con el Centro de Robótica de Stanford . "Con una pinza suave y Vocal Sandbox, una persona podría decir, '¿Puedes frotar más fuerte aquí?' o 'Eso es demasiado', lo que les da a los usuarios la capacidad de controlar verbalmente cómo el robot sigue los contornos de su cuerpo sin lastimarlos". Karamcheti ha visto a los robots hacer cada vez más cosas interesantes en entornos de laboratorio o en almacenes aislados sin gente involucrada, pero esos esfuerzos no nos han acercado a ver un robot implementado para colaborar con nosotros de una manera fácil y fluida, dice. “Quiero que el sistema Vocal Sandbox sea el primero de muchos sistemas en los que podamos poner un robot con una persona y que esta descubra cómo sacarle algún provecho y, a partir de ahí, desarrolle sus habilidades”, afirma. Esta colaboración entre robots puede acercarnos a un futuro en el que Rosie sea el robot.