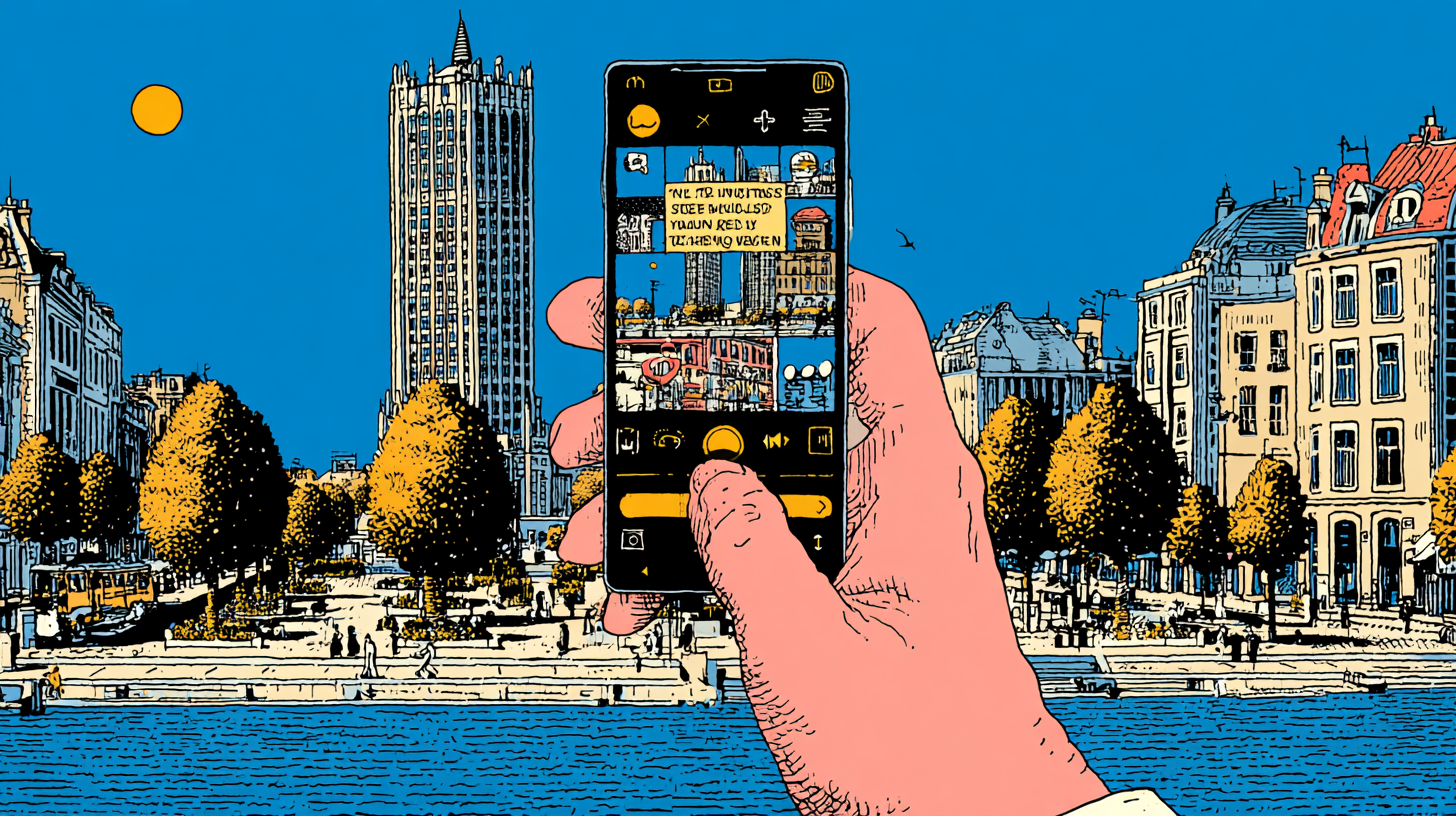

Por Cláudia Ascensão Nunes Bruselas ha acusado a TikTok de adoptar un diseño adictivo y exige cambios, extendiendo el alcance de la Ley de Servicios Digitales (DSA) de un regulador de contenido al diseño mismo de las plataformas. Más allá de las motivaciones, tal medida profundizaría la microgestión de la vida digital de los europeos, mientras que dicho alcance regulatorio impone cada vez más estándares que terminan moldeando la tecnología a nivel mundial. Durante años, la Unión Europea (UE) ha dirigido una batalla contra las grandes empresas tecnológicas. A través de normativas como la DSA, la Ley de Mercados Digitales (DMA) y el Reglamento General de Protección de Datos (GDPR), Bruselas ha creado un entorno regulatorio complejo, burocrático y punitivo que dificulta el surgimiento y crecimiento de empresas tecnológicas europeas verdaderamente competitivas. Mientras impone reglas cada vez más intrusivas a las plataformas extranjeras, Europa no ha logrado producir sus propios gigantes tecnológicos. En lugar de fomentar la innovación mediante la libre competencia y la libertad empresarial, la UE ha optado por regular con mano dura a las empresas existentes. El resultado es un panorama de innovación europea limitada y una creciente dependencia de tecnologías desarrolladas fuera del continente; las mismas tecnologías que, a su vez, Bruselas sigue moldeando según sus preferencias regulatorias. Las grandes plataformas cumplen simplemente porque perder el acceso al mercado europeo no es una opción. En febrero de 2026, bajo la DSA, Bruselas concluyó que el diseño de TikTok es adictivo, citando violaciones a los Artículos 34 y 35, que exigen la evaluación y mitigación de riesgos sistémicos, incluidos los riesgos para la salud mental y los menores. Bruselas también citó el Artículo 25, que prohíbe las interfaces manipuladoras. Si la DSA fue diseñada originalmente para abordar el contenido en las plataformas —lo cual ya es un principio problemático en sí mismo, dado que coloca a una autoridad central a cargo de regular el discurso—, este nuevo paso va más allá. La UE está expandiendo ahora su interpretación de la ley vigente e interviniendo directamente en el diseño de las plataformas, alegando que ciertas funciones fueron creadas intencionalmente para fomentar el uso compulsivo. Al exigir medidas como limitar o desactivar el scroll infinito después de cierto tiempo, introducir descansos de pantalla obligatorios (incluso por la noche) y alterar los algoritmos de recomendación para hacerlos menos “adictivos”, la regulación se aleja del contenido y comienza a dictar cómo deben funcionar las plataformas. Aunque la protección de los niños es la principal justificación, estas medidas no se aplican solamente a los usuarios menores de edad. Las conclusiones de la Comisión también afectan a los adultos y, dado que las plataformas digitales operan con diseños globales unificados, las reglas adoptadas en Bruselas terminan moldeando las experiencias de los usuarios en todo el mundo, incluido Estados Unidos, donde las tensiones en torno a la DSA han aumentado. Un ejemplo proviene del informe “La amenaza de la censura extranjera, Parte II”, publicado en febrero del año 2026 por el Comité Judicial de la Cámara de Representantes de EE. UU. El informe, basado en miles de documentos internos obtenidos mediante citaciones judiciales, acusa a la Comisión Europea de presionar a las principales plataformas, a lo largo de más de 100 reuniones a puerta cerrada, para reforzar sus políticas de moderación de contenidos a nivel mundial, incluyendo la eliminación o supresión de contenido político e información fáctica que es legal en los Estados Unidos. Independientemente del enfoque político del informe, este resalta un riesgo creciente. Cuando los reguladores europeos imponen requisitos estrictos, las plataformas tienden a aplicar las mismas reglas en todo el mundo para evitar multas de hasta el 6% sobre sus ingresos globales. Penalizar el diseño que ha hecho exitosa a una aplicación va mucho más allá del papel adecuado del Estado y conlleva consecuencias más amplias para la innovación. Forzar a las empresas a alterar sus productos deliberadamente y abandonar las fórmulas que las hicieron exitosas desincentiva el progreso tecnológico, tanto para la empresa específica como para otras. Por encima de todo, este enfoque erosiona la responsabilidad individual. En lugar de confiar en que los padres y los propios usuarios gestionen sus hábitos digitales, el Estado asume el papel de un guardián omnipresente que decide qué es aceptable y qué no. A lo largo de la historia, la sociedad se ha adaptado constantemente a las nuevas tecnologías de entretenimiento e información. La televisión despertó décadas de preocupación por su impacto; sin embargo, estas inquietudes se abordaron en gran medida mediante la autorregulación de la industria, los sistemas de clasificación y las herramientas parentales. Los videojuegos desencadenaron pánicos morales aún más fuertes, desde el pinball hasta títulos como Mortal Kombat y Grand Theft Auto, pero finalmente se integraron a través de sistemas de clasificación y su reconocimiento como formas de expresión protegidas. En ambos casos, la adaptación llegó a través de la responsabilidad individual, la competencia del mercado y la innovación, sin que el Estado dictara cómo debían diseñarse técnicamente las tecnologías. La relación entre las personas y la tecnología debe basarse en la responsabilidad personal, no en mandatos gubernamentales excesivos que buscan reemplazar con control la libertad de innovar, de hablar y de consumir entretenimiento. ***Cláudia Ascensão Nunes es escritora y comentarista política. Es presidenta de Ladies of Liberty Alliance – Portugal.