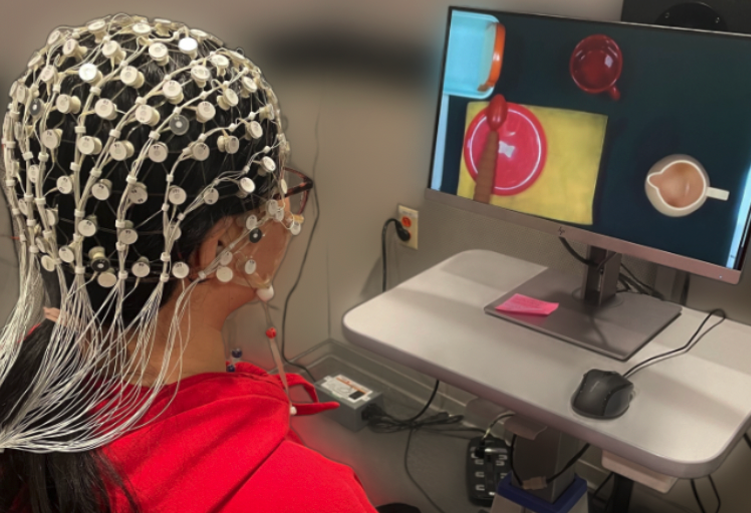

Por Andres Myers Investigadores de la Universidad de Stanford han desarrollado una gorra electrónica portátil capaz de leer ondas cerebrales (EEG) y permitir a las personas dirigir robots para mover objetos, limpiar encimeras, jugar al tres en raya, acariciar a un perro robot e incluso cocinar una comida sencilla. utilizando sólo sus señales cerebrales. Los investigadores lo llaman NOIR, Robots Inteligentes Operados por Señales Neurales, sin ningún drama criminal cínico involucrado. "El usuario primero se concentra en un objeto (un tazón o una batidora, por ejemplo) y en lo que quiere que suceda... verter el tazón en la batidora ... y el robot lo hace", dice Ruohan Zhang , investigador postdoctoral en el Laboratorio de Visión y Aprendizaje de Stanford. y co-primer autor del artículo que presenta NOIR , que se presentó recientemente en la Conferencia sobre Aprendizaje de Robots . Zhang tiene experiencia tanto en neurociencia como en informática y dice que ha estado pensando en NOIR durante casi una década. Aunque parezca simple, la ciencia detrás de NOIR es todo lo contrario. Los EEG (electroencefalógrafos), o un registro de la actividad eléctrica en el cerebro, son generalmente débiles, y usarlos para determinar a qué objetos está prestando atención el usuario y cómo quiere interactuar con el objeto es extremadamente difícil, explica Zhang. “No puedes hacerlo simplemente pidiéndoles que piensen en un objeto. En realidad, existen técnicas bastante maduras de la investigación en neurociencia, conocidas como potencial evocado visualmente en estado estacionario (SSVEP) e imágenes motoras”, dice. Ofrece un ejemplo: una persona se concentra en un objeto, digamos un plato, en la pantalla de una computadora. ¿Cómo sabe NOIR en qué objeto se está enfocando la persona? NOIR adjunta una máscara "parpadeante" a todos los objetos, pero estas máscaras parpadean a diferentes frecuencias. Esta señal parpadeante provoca fuertes respuestas en la corteza visual del cerebro. NOIR puede "ver" (identificar) ese objeto en los patrones de parpadeo del EEG que emanan de la corteza visual del usuario. Al leer estos patrones generados por las neuronas visuales que se activan cuando la persona mira diferentes objetos, los investigadores pueden identificar en qué objeto está pensando el usuario. Una vez que descubren a qué objeto está prestando atención el usuario, imaginan lo que el usuario quiere hacer: tomar el tazón blanco, moverlo a la batidora y verter el tazón en la batidora. Estas acciones físicas también son identificables en las ondas cerebrales. “Es una neurociencia bastante sorprendente. En realidad, es hermoso”, dice Zhang. La gorra electrónica se coloca encima de la cabeza del usuario, pero no es invasiva. No hay sondas ni electrodos en el cerebro mismo. Zhang va más allá al explicar que utilizando los algoritmos de aprendizaje robótico NOIR, con un poco de entrenamiento, puede adaptarse a nuevos usuarios y predecir sus deseos. Hasta ahora, los investigadores en el campo de la robótica han desarrollado sistemas para ayudar a los humanos a comunicar sus intenciones a los robots de muchas maneras: presionando botones, seguimiento ocular, expresiones faciales e incluso lenguaje escrito y hablado. Los EEG y otros tipos de señales cerebrales, dice Zhang, son el siguiente paso natural en esa progresión. "Creemos que NOIR tiene el potencial de mejorar las formas en que los humanos pueden interactuar con los robots utilizando comunicación neuronal directa que podría ser particularmente útil para personas con parálisis o disfunción motora, o para personas mayores con capacidades físicas limitadas", dice Zhang sobre la promesa que se avecina. . Sin embargo, antes de que llegue ese día queda mucho trabajo por delante. En este punto, NOIR es un ejemplo de prueba de concepto de que la IA puede decodificar con éxito una actividad compleja de ondas cerebrales y convertirla en acción robótica. En este punto, las acciones que NOIR puede realizar se limitan a unas 20 tareas relativamente simples, como cortar un plátano, jugar a las damas o desatar una cinta, pero Zhang y otros miembros del equipo de Stanford Vision and Learning Lab esperan expandir y perfeccionar. esas tareas en investigaciones posteriores. "Aunque no es perfecto, NOIR es mucho más capaz en comparación con las generaciones anteriores de esta tecnología y apunta a un día en el que los robots controlados por el pensamiento podrían estar en todos los hogares", dice Zhang.

Publicado el 24 ene. 2024

Un dispositivo portátil permite a los humanos controlar robots con ondas cerebrales